대형 언어 모델(Large Language Models, LLMs)은 방대한 데이터셋을 통해 학습된 인공지능 모델로, 다양한 언어 작업에서 혁신을 이끌고 있습니다. 주요 LLM들을 비교하고 평가하며, 이들의 기술적 특징과 활용 방안을 알아봅니다.

최근 인공지능 분야에서 대형 언어 모델(Large Language Models, LLMs)이 큰 주목을 받고 있습니다. 이 모델들은 방대한 양의 데이터를 학습하여 인간과 유사한 언어 이해와 생성을 가능하게 합니다. 이번 기사에서는 GPT-4, Gemini, PaLM 2 등 주요 LLM들을 비교하고, 이들의 기술적 특징과 활용 방안을 살펴보겠습니다. 인공지능이 어떻게 우리의 삶과 산업에 혁신을 가져다주는지 알아보세요.

대형 언어 모델(LLMs)이란?

정의와 역할

대형 언어 모델(Large Language Models, LLMs)은 방대한 데이터셋을 바탕으로 학습하여 자연어를 이해하고 생성하는 모델입니다. 이러한 모델들은 텍스트 문서에서 통계적 패턴을 학습해 다양한 언어 관련 작업을 수행할 수 있습니다. 주요 응용 분야로는 텍스트 생성이 있으며, 이는 주어진 입력 텍스트를 기반으로 다음 단어를 예측하는 방식으로 작동합니다. LLMs는 인공지능 분야에서 중요한 진전을 이뤘으며, 여러 산업에서 혁신적으로 활용되고 있습니다.

기술적 특징

대형 언어 모델들은 주로 트랜스포머 기반의 아키텍처를 사용합니다. 트랜스포머는 순차적 데이터를 효과적으로 처리하고 문맥을 이해하는 데 뛰어난 성능을 발휘합니다. 이러한 모델들은 다층 신경망으로 구성되어 있으며, 각 층은 학습 과정에서 최적화된 조정 가능한 파라미터를 포함하고 있습니다.

어텐션 메커니즘(Attention Mechanism)

트랜스포머 기반 모델의 중요한 특징 중 하나는 어텐션 메커니즘니다. 이 메커니즘은 문장 내의 다른 단어들의 중요도를 가중치로 계산하여 모델이 중요한 정보에 집중할 수 있도록 합니다. 이를 통해 문맥과 언어의 뉘앙스를 더 잘 이해할 수 있습니다.

문맥적 단어 표현

기존 언어 모델들이 단어를 개별적으로 취급하는 것과 달리, 대형 언어 모델들은 단어의 문맥적 표현을 생성합니다. 이는 단어의 의미가 문맥에 따라 달라질 수 있음을 반영하여 더 정교한 언어 이해를 가능하게 합니다.

확장성

대형 언어 모델들은 제공되는 데이터의 양에 따라 확장 가능합니다. 더 많은 데이터를 학습할수록 언어를 이해하고 생성하는 능력이 향상됩니다. 이러한 확장성은 모델의 성공과 지속적인 발전의 핵심 요소입니다.

대형 언어 모델의 발전과 도전 과제

컴퓨팅 자원

대형 언어 모델을 훈련시키기 위해서는 막대한 컴퓨팅 자원이 필요합니다. 모델의 크기와 데이터의 양이 증가함에 따라 필요한 자원도 증가하여, 소규모 조직이 이를 활용하기 어려운 경우가 많습니다. 이러한 문제를 해결하기 위해 클라우드 기반의 컴퓨팅 자원이나 효율적인 알고리즘 개발이 중요합니다.

데이터 품질과 편향

훈련 데이터의 품질은 모델의 성능에 직접적인 영향을 미칩니다. 데이터 내의 편향은 모델 출력에 영향을 미칠 수 있으며, 이는 윤리적 문제와 공정성 문제를 야기할 수 있습니다. 따라서 데이터의 공정성과 다양성을 보장하기 위한 노력이 필요합니다.

해석 가능성

대형 언어 모델이 점점 복잡해짐에 따라, 모델이 어떻게 결정을 내리는지를 이해하는 것이 더욱 어려워집니다. 모델의 투명성과 해석 가능성을 보장하는 것은 계속되는 연구 분야입니다. 이는 모델의 신뢰성을 높이고, 사용자들이 모델의 결과를 이해하고 신뢰할 수 있도록 합니다.

주요 대형 언어 모델들

GPT-4

GPT-4는 OpenAI에서 개발한 대형 멀티모달 언어 모델로, 텍스트와 이미지를 처리할 수 있는 능력을 갖추고 있습니다. 이는 다양한 분야에서 활용될 수 있는 탁월한 성능을 자랑합니다. GPT-4는 이전 버전에 비해 향상된 이해력과 창의력을 보여줍니다.

Gemini

Gemini는 Google DeepMind에서 개발한 멀티모달 대형 언어 모델로, 텍스트, 이미지, 오디오, 비디오, 코드 등의 다양한 데이터 유형을 동시에 처리할 수 있는 능력을 갖추고 있습니다. 이는 인간-컴퓨터 상호작용, 콘텐츠 생성, 문제 해결 등 다양한 분야에서 혁신을 이끌고 있습니다.

PaLM 2

PaLM 2는 Google이 개발한 모델로, 코드 생성, 수학 문제 해결, 번역 등 다양한 복잡한 작업을 수행할 수 있습니다. 이 모델은 효율성, 속도, 비용 면에서 최적화되어 있습니다. 또한, PaLM 2는 다양한 언어와 과학 논문, 웹 페이지, 코드 등을 학습하여 다방면에서 뛰어난 성능을 보여줍니다.

Llama 2

Llama 2는 Meta AI에서 개발한 모델로, 대화 작업에 특히 강점을 가지고 있으며, 다양한 응용 분야에서 활용될 수 있습니다. 이 모델은 대규모 데이터셋을 학습하여 사용자와의 상호작용에서 높은 정확성과 자연스러움을 제공합니다.

Vicuna

Vicuna는 AI 연구를 용이하게 하기 위해 설계된 모델로, 질문-응답 형식을 통해 다양한 LLM을 비교하고 평가할 수 있습니다. 이는 연구자들이 다양한 모델의 성능을 비교하고 개선하는 데 도움이 됩니다.

Claude

Claude 는 Anthropic에서 개발한 AI 모델로, 코딩, 수학, 논리적 추론 작업에서 뛰어난 성능을 보여줍니다. Claude 2는 사용자의 요청에 맞춰 긴 문서나 기술 매뉴얼 등을 처리할 수 있는 능력을 갖추고 있습니다.

Falcon

Falcon은 다양한 크기의 모델로 구성되어 있으며, 멀티랭귀지 기능을 갖추고 있어 여러 언어로 작업을 수행할 수 있습니다. Falcon 모델은 높은 정확도와 효율성을 자랑하며, 다양한 산업에서 활용될 수 있습니다.

MPT

MPT는 MosaicML에서 개발한 모델로, 고급 AI 기술을 민주화하고 상업적으로 사용 가능한 플랫폼을 제공하는 것을 목표로 합니다. MPT 모델은 최적화된 아키텍처와 고급 기법을 사용하여 효율적이고 빠른 성능을 제공합니다.

Mixtral 8x7B

Mixtral 8x7B는 Mistral AI에서 개발한 모델로, 혁신적인 전문가 혼합 아키텍처를 특징으로 합니다. 이 모델은 다중 언어 지원 및 코드 생성 작업에서 뛰어난 성능을 발휘합니다.

Grok

Grok은 xAI에서 개발한 고급 챗봇으로, 유머러스하고 실시간 정보를 제공할 수 있는 독특한 대화 경험을 제공합니다. Grok은 다양한 작업을 수행할 수 있으며, 사용자와의 상호작용에서 높은 만족도를 제공합니다.

StableLM

StableLM은 Stability AI에서 개발한 오픈 소스 대형 언어 모델로, 대화 및 코딩 작업에서 뛰어난 성능을 보여줍니다. StableLM은 광범위한 데이터셋을 학습하여 높은 정확도와 효율성을 자랑합니다.

LLM 리더보드 ( LLMs 비교 사이트)

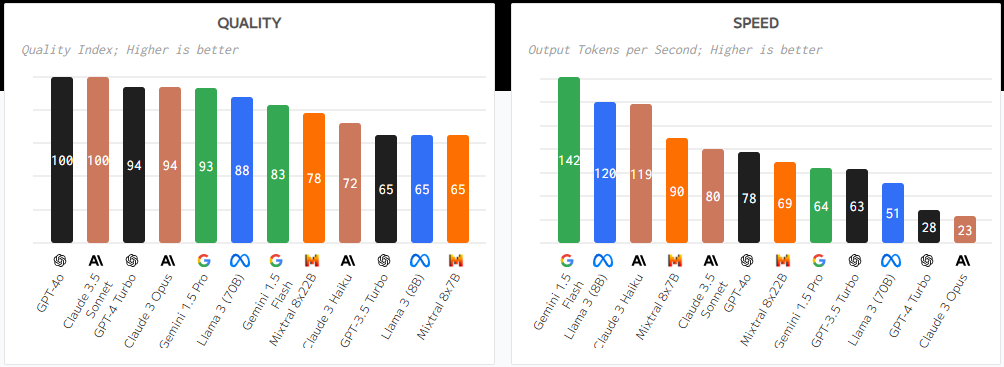

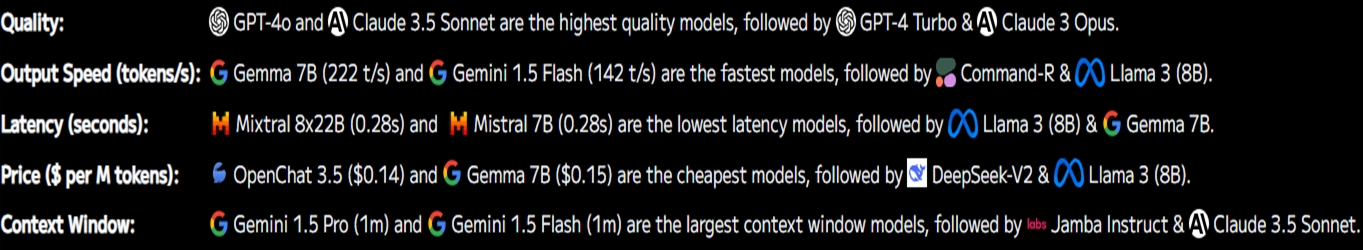

artificialanalysis.ai 의 'LLM 리더보드'에서는 GPT-4o, 라마 3, 미스트랄, 제미니 및 30개 이상의 모델 비교 결과를 확인할 수 있습니다.

모델별 품질, 가격, 성능, 속도(출력 속도 - 초당 토큰 수 및 지연 시간 - TTFT), 컨텍스트 창 등 주요 지표에 걸쳐 30개 이상의 AI 모델(LLM)의 성능을 비교하고 순위를 매깁니다.

6/26 현재

싱글 병렬 쿼리, 1,000토큰 기준 성능 순위는 아래와 같습니다. 최근 출시된 클로드 3.5 소네트의 약진이 놀랍습니다.

LLM Leaderboard - Compare GPT-4o, Llama 3, Mistral, Gemini & other models | Artificial Analysis

Comparison and ranking the performance of over 30 AI models (LLMs) across key metrics including quality, price, performance and speed (output speed - tokens per second & latency - TTFT), context window & others.

artificialanalysis.ai

결론

대형 언어 모델은 AI 발전의 핵심 요소로, 다양한 작업에서 혁신을 이끌고 있습니다. 각 모델은 고유한 강점과 특징을 가지고 있어, 특정 용도에 맞는 최적의 모델을 선택하는 것이 중요합니다. 앞으로도 대형 언어 모델의 발전은 계속될 것이며, 이는 우리의 일상과 산업 전반에 걸쳐 긍정적인 영향을 미칠 것입니다.